概要

FLUX.2 [klein] をローカル環境で動かしてみました。

画像生成・画像編集が高速に行えるとされている FLUX.2 [klein] ですが、

- ローカル環境でも動作可能

- FP8 量子化モデルで超高速

- 画像生成・画像編集ともに実用的な速度

という点で、かなり扱いやすいモデルだと感じました。

生成時間が 10 秒を下回ってくると、体感的にも非常に快適だと感じます。

FLUX.2

FLUX.2 は、Black Forest Labs がリリースした「画像生成+画像編集」対応の AI モデルです。

前モデルである FLUX.1 と比べ、画質・操作性・制御性が大幅に向上しています。

ドキュメント

https://docs.bfl.ai/flux_2

FLUX.2 には複数のバリエーションがありますが、オープンウェイトなのは FLUX.2 [dev] と FLUX.2 [klein] です。

- FLUX.2 [max]

最高品質・最高性能のモデル - FLUX.2 [pro]

高画質で、コストと速度のバランスが良い - FLUX.2 [flex]

ステップ数やガイダンスを柔軟に調整可能 - FLUX.2 [dev]

開発・研究向けモデル - FLUX.2 [klein]

軽量・超高速・低レイテンシ

※ klein はドイツ語で「小さい」を意味します

FLUX.2 [klein], FLUX.2 [dev]

FLUX.2 [klein] および FLUX.2 [dev] は Hugging Face で公開されています。

https://huggingface.co/collections/black-forest-labs/flux2

- FLUX.2-dev

FLUX.2 の開発・研究向けオープンウェイトモデルです。 - FLUX.2-klein-4B / 9B 系

軽量・超高速モデルで、ローカル実行やリアルタイム生成に適しています。 - ベースモデル

FLUX.2-klein-base-4B / base-9B

蒸留されていないベース(未蒸留)重み。ファインチューニング用途向け - 量子化・最適化バージョン

FP8 量子化:VRAM 使用量削減と高速化を目的としたバージョン

NVFP4:NVIDIA GPU 向けにさらに最適化

ライセンス

- FLUX.2-dev

FLUX [dev] Non-Commercial License v2.0

→ 商用利用不可

https://huggingface.co/black-forest-labs/FLUX.2-dev/blob/main/LICENSE.txt - FLUX.2-klein-4B

Apache 2.0 ライセンス

→ 商用利用可能

https://choosealicense.com/licenses/apache-2.0/

https://huggingface.co/datasets/choosealicense/licenses/blob/main/markdown/apache-2.0.md - FLUX.2-klein-9B

FLUX Non-Commercial License v2.1

→ 商用利用不可

https://huggingface.co/black-forest-labs/FLUX.2-klein-9B/blob/main/LICENSE.md

Comfy Org による再パッケージ版

Confy Org による再パッケージ版も公開されており、今回はこちらの情報を参考にします。

https://docs.comfy.org/tutorials/flux/flux-2-klein

Hugging Face

https://huggingface.co/Comfy-Org/flux2-klein-4B

ローカル実行環境の用意

PC 環境

NVIDIA GeForce RTX 5060 Ti 16GB を搭載した自作 PC で行います。

Stability Matrix + ComfyUI の実行環境の用意

ComfyUI は、以前 Stability Matrix で用意したものを使います。準備方法については、過去記事をご参照ください。

準備

古いバージョンだと正常に動作しない可能性があるため、事前に更新しておきます。

- Stability Matrix – Settings – アップデート

- Stability Matrix – パッケージ – ComfyUI の更新

以下では、

Stability Matrix 2.15.5

ComfyUI v0.9.2

で試しています。

必要なファイルのダウンロード

ComfyUI v0.9.2 では、FLUX.2 [klein] のワークフローがまだ統合されていなかったので、手動で用意します。

最初にワークフローファイルをダウンロードして、ComfyUI でワークフローを開くと、足りないファイルがダウンロードできるのでそのやり方が早いです。

(1) ワークフローのダウンロード

以下のサイトにアクセスします。

https://docs.comfy.org/tutorials/flux/flux-2-klein

「Flux.2 Klein 4B Workflows」セクションから、以下のワークフローを json ファイルとしてダウンロードします。

(.txt で保存された場合は .json に変更します。)

- 4B Text-to-Image Workflow (テキストから画像を生成するワークフロー) : 今回はこれを使用

image_flux2_klein_text_to_image.json - 4B Image Edit Base (ベースモデルを使った画像編集用ワークフロー)

image_flux2_klein_image_edit_4b_base.json - 4B Image Edit Distilled (FP8モデルを使った画像編集用ワークフロー) : 今回はこれも使用

image_flux2_klein_image_edit_4b_distilled.json

(2) 拡散モデル、テキストエンコーダー、VAE のダウンロード

ComfyUI を起動して、image_flux2_klein_text_to_image.json をドラックアンドドロップします。

不足しているファイルがある場合、ポップアップが表示されるのでダウンロードします。

- flux-2-klein-base-4b.safetensors

- qwen_3_4b.safetensors

- fux2-vae.safetensors

- flux-2-klein-4b.safetensors

次に image_flux2_klein_image_edit_4b_distilled.json もドラックアンドドロップします。

追加で以下をダウンロードします。

- flux-2-klein-4b-fp8.safetensors

ファイルの配置

ComfyUI の models フォルダには配置せず、Stability Matrix の Models フォルダ配下に配置します。

(1) Diffusion モデル

flux-2-klein-4b-fp8.safetensors, flux-2-klein-base-4b.safetensors, flux-2-klein-4b.safetensors

→ StabilityMatrix のインストールフォルダ\Data\Models\TextEncoders\Data\Models\DiffusionModels

(2) テキストエンコーダ

qwen_3_4b.safetensors

→ StabilityMatrix のインストールフォルダ\Data\Models\TextEncoders

(3) VAE

fux2-vae.safetensors

→ StabilityMatrix のインストールフォルダ\Data\Models\TextEncoders\Data\Models\VAE

C:\StablilityMatrix にインストールしている場合は以下のような形です:

C:\STABILITYMATRIX\DATA\MODELS

├─DiffusionModels

│ flux-2-klein-4b-fp8.safetensors

│ flux-2-klein-4b.safetensors

│ flux-2-klein-base-4b.safetensors

├─TextEncoders

│ qwen_3_4b.safetensors

└─VAE

flux2-vae.safetensors画像生成を行ってみた

テキストから画像生成 – ベースモデル

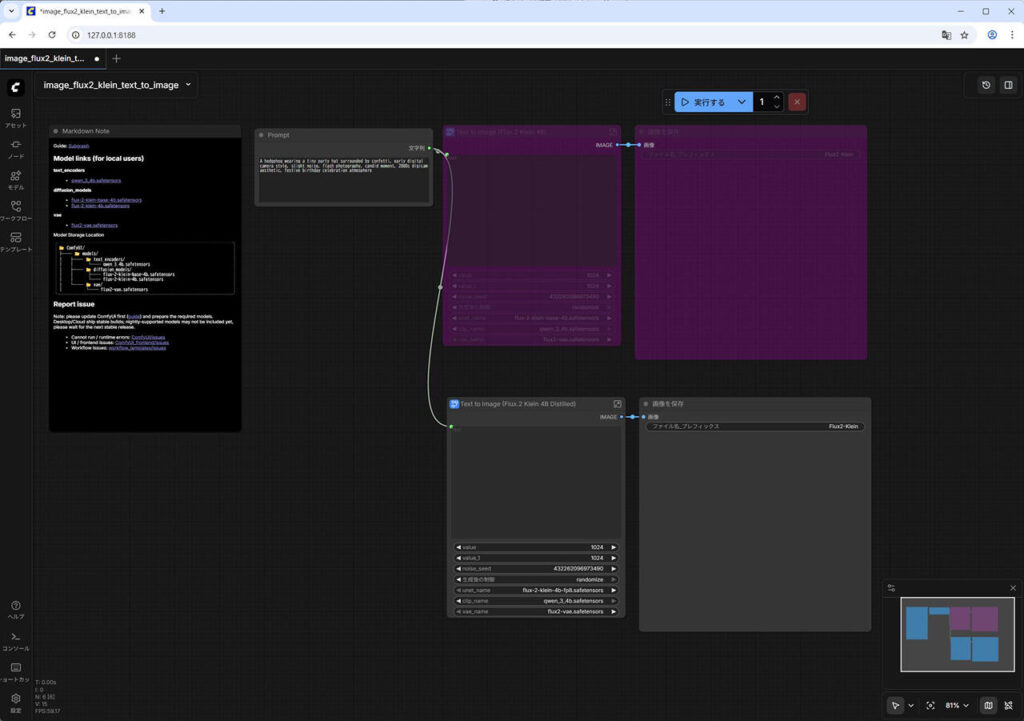

image_flux2_klein_text_to_image.json のワークフローを開きます。

デフォルトでは、プロンプトは以下になっています。

A hedgehog wearing a tiny party hat surrounded by confetti, early digital camera style, slight noise, flash photography, candid moment, 2000s digicam aesthetic, festive birthday celebration atmosphereまずは、そのまま [実行する] をクリックします。

約 43 秒で生成されました。

初回は モデルを VRAM やメモリに読み込むのでその分少し時間がかかります。

そのままプロンプトだけ変えて実行します。

ここでは FLUX.1 [schnell] で試したサンプルと同じプロンプトにしてみます。

2回目は 約 38 秒かかりました。

a bottle with a beautiful rainbow galaxy inside it on top of a wooden table in the middle of a modern kitchen beside a plate of vegetables and mushrooms and a wine glasse that contains a planet earth with a plate with a half eaten apple pie on it

テキストから画像生成 – 蒸留モデル

次に、蒸留モデルでの画像生成を試します。

(1) 必要に応じて image_flux2_klein_text_to_image.json のワークフローファイルを読み込みなおします。

(2) 右上の [Text to Image (Flux.2 Klein 4B)] と [画像を保存] のノードをそれぞれ右クリックして [バイパス] を選択します。

→ 紫色になり無効化されたことを確認します。

(3) 右下の [Text to Image (Flux.2 Klein 4B Distilled)] と [画像を保存] のノードをそれぞれ右クリックして [バイパス] を選択します。

実行します。蒸留モデルだと 約10秒で生成できました。

プロンプトを変えて再実行します。 約8秒で生成できました。

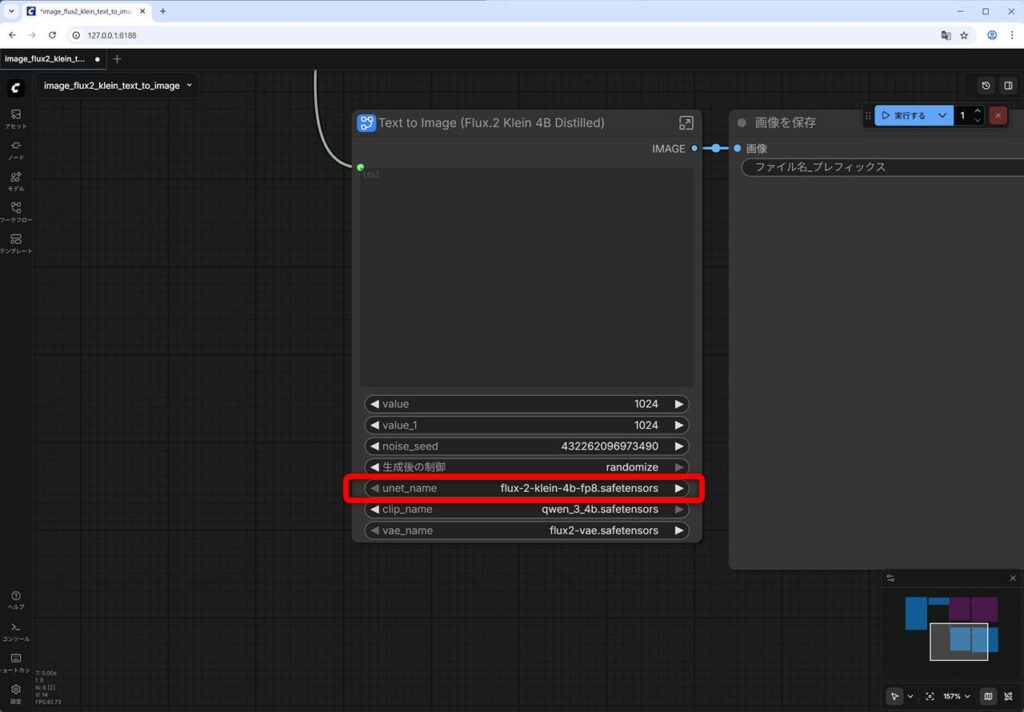

テキストから画像生成 – FP8 量子化モデル

さらに FP8 量子化モデルで試します。

(1) 必要に応じて image_flux2_klein_text_to_image.json のワークフローファイルを読み込みなおします。

(2) 右上の [Text to Image (Flux.2 Klein 4B)] と [画像を保存] のノードをそれぞれ右クリックして [バイパス] を選択します。

→ 紫色になり無効化されたことを確認します。

(3) 右下の [Text to Image (Flux.2 Klein 4B Distilled)] と [画像を保存] のノードをそれぞれ右クリックして [バイパス] を選択します。

(4) [Text to Image (Flux.2 Klein 4B Distilled)] ノードの [unet_name] を flux-2-klein-4b-fp8.safetensors に変更します。

画像を生成します。約 4.5秒で生成できました。

プロンプト変更後も、約 4.5秒で生成できました。

10秒以下になってくると、体感的には非常に速く感じますね。

画像編集を行ってみる。

次に画像の編集を行います。

利用するワークフローは、image_flux2_klein_image_edit_4b_distilled.json です。

元画像は、Qwen Image で生成した以下にします。

今回は読み込む画像は1枚なので、右下の2つのノードは右クリックからバイパスし、右上の2つのノードを有効化します。

変更を指示するプロンプトに以下を入力します。

wearing a white down jacket

生成します。約 9秒かかりました。

プロンプト変えてみます。

running and jumping生成します。こちらも 9秒程度かかりました。

さらに試してみます。いずれも 9秒程度で生成されました。

wearing glasses

chasing a soccer ball on a soccer field

参考となれば幸いです。

▼ 関連