概要

Stable Zero123 は、Stability AI によって開発された 視点条件付き(view-conditioned)画像生成モデルです。

2D (画像) から 3D を生成できます。

ローカル PC でに環境を用意して使ってみたので情報残しておきます。

Stable Zero123 が NVIDIA GeForce RTX 5060Ti 16GB でどこまで動くのかについて参考になれば幸いです。

Stable Zero123 とは

Stable Zero123 は、Stability AI によって開発された 視点条件付き(view-conditioned)画像生成モデルです。単一の入力画像から複数の新しい視点の画像を生成し、それをもとに 3D 再構築を行えます。

公式サイト

https://stability.ai/news/stable-zero123-3d-generation

https://huggingface.co/stabilityai/stable-zero123

バージョンおよびライセンス

Stable Zero123 には2つのバージョンがあります。

- Stable Zero123 (非商用版)

- Stable Zero123C (商用対応版)

Stable Zero123(非商用版)

- Stability AI Non‑Commercial Research Community License で提供。

- 商用利用は禁止されており、 個人の趣味利用や研究目的での使用に限られます。

https://huggingface.co/stabilityai/stable-zero123/raw/main/LICENSE_stable_zero123.md - モデルには CC‑BY‑NC ライセンス付きの3Dオブジェクトが含まれており、商用利用できません。

https://huggingface.co/stabilityai/stable-zero123#model-details

Stable Zero123C(商用対応版)

本稿更新時点では、Stable Zero123C は Community のライセンスに含まれています。

https://stability.ai/license

https://stability-ai.squarespace.com/core-models

- StabilityAI Community License が適用され、商用利用可能です。ただし商用には Stability AI のメンバーシップ登録が必要です。

- 年間収益が 100万ドルを超える組織・企業の場合、Community License の対象外となり Enterprise ライセンス契約が必要となります。

https://huggingface.co/stabilityai/stable-zero123/blob/main/LICENSE_stable_zero123_c.md

Stable Zero123C を使ってみる (Stability Matrix + ComfyUI で使う)

Stability Matrix で用意した ComfyUI 環境で Stable Zero123C を使ってみます。

(非商用版の Stable Zero123 もチェックポイントファイルだけ変更すれば同様に利用できます。)

参考情報

ComfyUI examples などの情報を参考にしています。

https://comfyanonymous.github.io/ComfyUI_examples/3d

https://comfyuidoc.com/ja/Examples/3d/

https://comfyui-wiki.com/ja/comfyui-nodes/conditioning/3d-models/stablezero123-conditioning

https://comfyui-wiki.com/ja/comfyui-nodes/conditioning/3d-models/stablezero123-conditioning-batched

PC 環境

NVIDIA GeForce RTX 5060Ti 16GBを入れて自作した PC で行います。

ComfyUI の実行環境の用意

ComfyUI は、以前 Stability Matrix で用意したものを使います。準備方法はこの過去記事をご参照ください。

モデルファイルやサンプル画像 および ワークフローファイルの準備

Stable Zero123C のモデルファイル (チェックポイントファイル) をダウンロードします。

モデルファイルのダウンロードと配置

(1) Stable Zero123 の Hugging Face のサイトにアクセスします。

https://huggingface.co/stabilityai/stable-zero123

(2) [Files and Versions] タブをクリックして、stable_zero123_c.ckpt の 右のダウンロードボタンからダウンロードします。

(3) ダウンロードした stable_zero123_c.ckpt を Stability Matrix のチェックポイント用のフォルダに配置します。

- StabilityMatrixのインストールフォルダ\Data\Models\StableDiffusion

例) C:\StabilityMatrix にインストールした場合

C:\StabilityMatrix\Data\Models\StableDiffusion

ワークフローとサンプル画像のダウンロード

(4) ComfyUI_examples の Stable Zero123 のページにアクセスします。

https://comfyanonymous.github.io/ComfyUI_examples/3d

ワークフローのダウンロード: このページに表示されている画像を右クリックして、[名前を付けて画像を保存] から stable_zero123_example.png を保存します。

サンプル画像のダウンロード : [The input image can be found here] の here のリンクを右クリックして [名前を付けてリンク先を保存] から hypernetwork_example_output.png ファイルを保存します。

ComfyUI の起動とワークフローの実行

(1) Stability Matrix から ComfyUI を起動します。

Stability Matrix を起動 – 左側 [パッケージ] – ComfyUI – Launch

表示された URL (http://127.0.0.1:8188 ) にブラウザでアクセスします。

(2) 保存していた stable_zero123_example.png をファイルをドラックアンドドロップします。

(3) 以下の変更を行います。

| ノード名 | 選択項目 |

|---|---|

| 画像のみのチェックポイントローダ (img2vidモデル) | ckpt_name : stable_zero123_c.ckpt |

| 画像を読み込む | [アップロードするファイルを選択] をクリックして、ダウンロードしていた hypernetwork_example_output.png を選択 |

(4) [実行する] をから生成します。

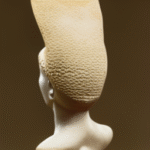

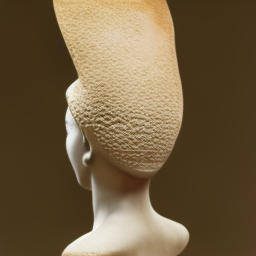

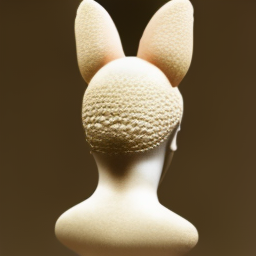

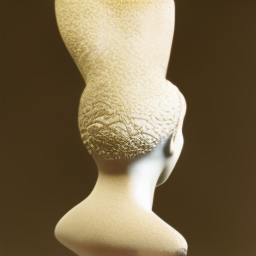

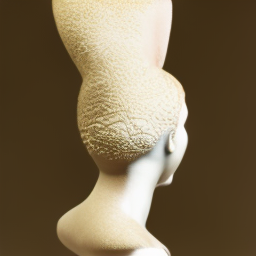

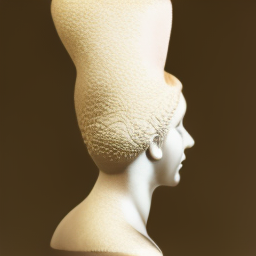

以下の画像が生成されます。

3D ぽくなるようにワークフローを変更

正面画像から存在していなかった部分が生成されましたが、思っていた 3D とちょっと違います。

もう少し 3D ぽくなるようにワークフローを変更します。

まずは、回転させながら複数の画像を一括生成する

(5) ノードを1つ追加します。

- [安定ゼロ123条件付け (バッチ) ] ノード

何もないところを右クリックして、[ノードを追加] – [条件付け] – [3D] – [安定ゼロ123条件付け (バッチ) ] を選択

![[安定ゼロ123条件付け (バッチ) ] のノードを追加](https://iwannacreateapps.com/wp-content/uploads/2025/07/StableZero123_09-150x101.jpg)

これを既存の [安定ゼロ123条件付け] のノードを消して入れ替えます。

すなわち、接続としては以下のようになります。

| 接続元ノードと出力名 | 接続先ノードの入力名 |

|---|---|

| 画像のみのチェックポイントローダ (img2vidモデル) CLIP_VISION | 安定ゼロ123条件付け (バッチ) クリップビジョン |

| 画像のみのチェックポイントローダ (img2vidモデル) VAE | 安定ゼロ123条件付け (バッチ) VAE |

| 画像を読み込む 画像 | 安定ゼロ123条件付け (バッチ) 初期画像 |

| 安定ゼロ123条件付け (バッチ) ポジティブ | Kサンプラー ポジティブ |

| 安定ゼロ123条件付け (バッチ) ネガティブ | Kサンプラー ネガティブ |

| 安定ゼロ123条件付け (バッチ) 潜在 | Kサンプラー 潜在画像 |

| 項目 | 選択項目 |

|---|---|

| バッチサイズ | 24 |

| 方位角バッチ増分 | 15.0 |

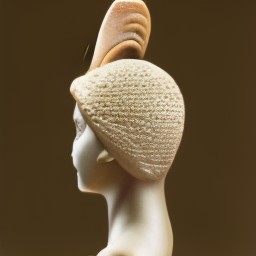

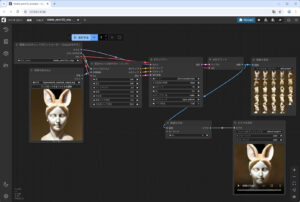

出来上がった様子は以下です。

(この json ファイルを右クリックから名前を付けて保存したあと、ComfyUI にドラックアンドドロップすれば再現できます。)

![[安定ゼロ123条件付け (バッチ) ] のノードを接続して、設定を変更](https://iwannacreateapps.com/wp-content/uploads/2025/07/StableZero123_10-150x101.jpg)

ここでいったん実行してみます。

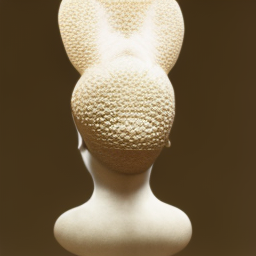

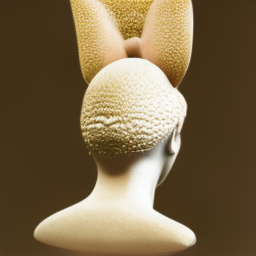

15度ずつ水平方向に回転しながら、24枚の画像が生成されました。 (15度 x 24 で 360度一周分)

![[安定ゼロ123条件付け (バッチ) ] で複数の角度の画像を一括生成](https://iwannacreateapps.com/wp-content/uploads/2025/07/StableZero123_11-150x101.jpg)

生成された画像から動画を作成する

(6) ノードを2つ追加します。

- [動画を作成] ノード

何もないところを右クリックして [ノードを追加] – [画像] – [動画を作成] をクリック - [ビデオを保存] ノード

何もないところを右クリックして [ノードを追加] – [画像] – [ビデオを保存] をクリック

![[動画を作成] のノードを追加](https://iwannacreateapps.com/wp-content/uploads/2025/07/StableZero123_12-150x101.jpg)

![[ビデオを保存] のノードを追加](https://iwannacreateapps.com/wp-content/uploads/2025/07/StableZero123_13-150x101.jpg)

これらのノードを以下のように接続します。

| 接続元ノードと出力名 | 接続先ノードの入力名 |

|---|---|

| VAE デコード 画像 | 動画を作成 画像 |

| 動画を作成 ビデオ | ビデオを保存 ビデオ |

さらに [動画を作成] のノードで以下の設定を行います。

| 項目 | 選択項目 |

|---|---|

| fps | 4 |

ここはお好みで調整してください。

この例では、24枚の画像が生成されており、1秒当たり4フレームとなるので、6秒で1回転が見える動画になります。

fps を 24 にすれば 24枚が1秒で表示される動画になります。)

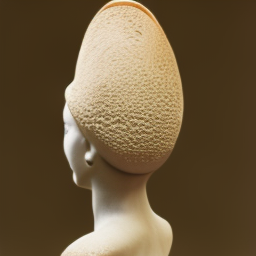

完成したワークフローは以下です。(この json もおいておきます。)

![[動画を作成] と [ビデオを保存] のノードを追加して設定したあと](https://iwannacreateapps.com/wp-content/uploads/2025/07/StableZero123_14-150x101.jpg)

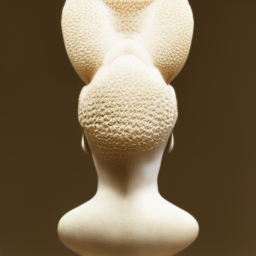

改めて実行します。

作成された動画は以下です。3Dぽくなりました。

バッチ処理として、高度、方位角およびその増分を変えていけば、いろいろと生成できると思います。

これを生成するのに NVIDIA GeForce RTX 5060Ti 16GB だと 数秒で完了しました。

参考となれば幸いです。